ChatGPT отримав функцію сповіщення близьких про ризик суїциду

- OpenAI запровадила Trusted Contact — функцію сповіщення контактної особи у разі ризику самоушкодження користувача ChatGPT.

- Користувачі від 18 років можуть вказати одну довірену особу, яка отримає email, SMS або сповіщення у застосунку.

- Процес не автоматизований — кожне сповіщення проходить перевірку навченою командою OpenAI, мета — розглянути за годину.

- Транскрипт розмови контактній особі не надається з міркувань конфіденційності.

OpenAI запровадила функцію Trusted Contact для ChatGPT, яка дозволяє користувачам додавати контактну особу, яку компанія може сповістити у разі ризику самоушкодження. За даними OpenAI, понад мільйон із 800 мільйонів щотижневих користувачів ChatGPT висловлюють суїцидальні думки у розмовах із чатботом.

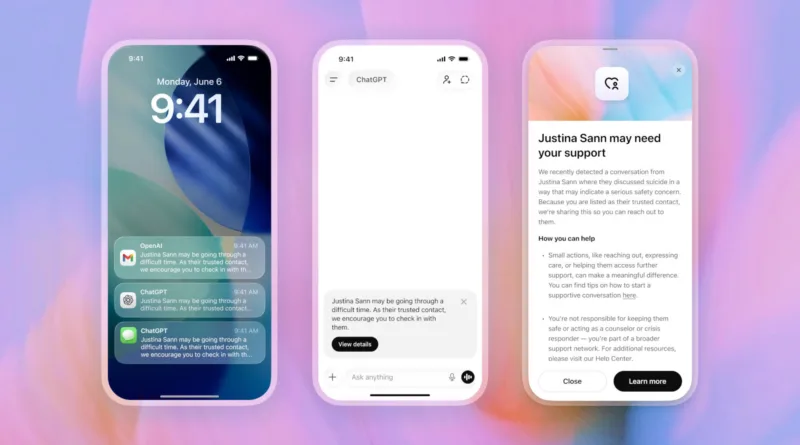

Функція доступна для користувачів від 18 років. У налаштуваннях ChatGPT можна вказати одну дорослу людину як Trusted Contact — вона має прийняти запрошення протягом тижня. Перед активацією система попередить користувача про те, що компанія може повідомити контактну особу у разі виявлення серйозного ризику самоушкодження. ChatGPT також заохочуватиме користувача самостійно звернутися до обраної людини та запропонує теми для початку розмови.

Процес не є повністю автоматизованим. Ситуацію перевіряє спеціально навчена команда співробітників OpenAI, і лише після підтвердження серйозного ризику контактна особа отримає електронного листа, SMS або сповіщення у застосунку. У повідомленні буде зазначено, що користувач може переживати важкий період, та міститиметься заклик зв’язатися з ним. Контактна особа також отримає доступ до деталей попередження з інформацією про те, що в розмові обговорювалась тема суїциду. Транскрипт розмови надаватись не буде з міркувань конфіденційності. Компанія зазначає, що прагне розглядати такі сповіщення менш ніж за годину.

Trusted Contact розроблено на базі батьківського контролю ChatGPT. Передісторія функції пов’язана з низкою резонансних інцидентів: у 2025 році OpenAI зіткнулась із позовом про неправомірну смерть підлітка, а розслідування BBC виявило випадок, коли ChatGPT надав користувачці інструкції щодо способу суїциду.