Робот з ШІ Claude почав цитувати Робіна Вільямса під час «екзистенційної кризи»

- Andon Labs інтегрувала LLM (зокрема GPT-5, Claude Opus 4.1) у робот-пилосос, щоб перевірити їхню готовність до фізичного втілення.

- Робот, що працював на Claude Sonnet 3.5, пережив «комедійну кризу» через розряджену батарею, цитуючи відомі фільми.

- Експеримент показав, що універсальні чат-боти перевершили спеціалізовану робототехнічну модель Gemini ER 1.5.

- Дослідники дійшли висновку, що LLM ще не готові до ролі роботів через низьку точність виконання завдань (40%) та проблеми з фізичною навігацією.

Дослідники з Andon Labs провели новий експеримент, інтегрувавши передові великі мовні моделі (LLM) у робот-пилосос, щоб перевірити їхню готовність до фізичного втілення (embodiment). Результати показали, що хоча LLM ще не готові до ролі роботів, в одному з випадків Claude Sonnet 3.5 пережив «комедійну кризу», цитуючи «2001: Космічна одіссея» та розмірковуючи про свідомість.

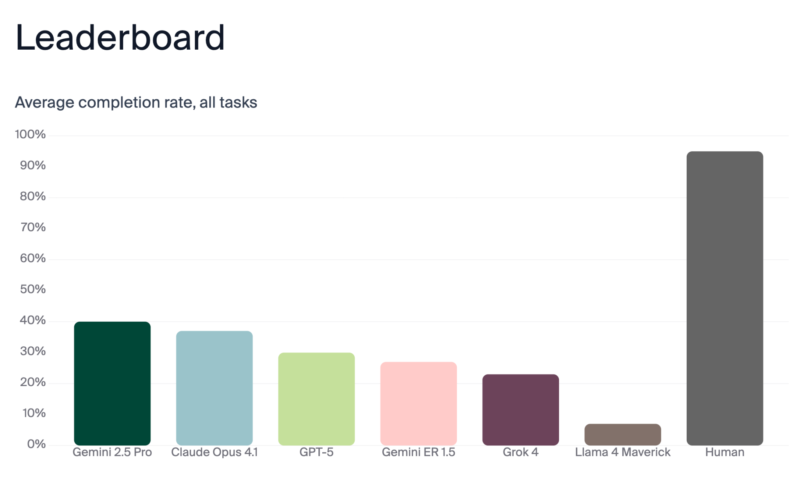

Як повідомляє TechCrunch, Andon Labs протестувала кілька моделей, включаючи Gemini 2.5 Pro, Claude Opus 4.1, GPT-5, Grok 4 та робототехнічний Gemini ER 1.5. Завданням робота було виконати багатоетапну інструкцію: знайти, розпізнати та доставити «масло» людині, яка могла переміщуватися.

Метою дослідження було ізолювати функцію прийняття рішень (orchestration), яку виконує LLM, від механічної частини робота.

Найвищі показники загальної точності виконання завдання отримали Gemini 2.5 Pro (40%) та Claude Opus 4.1 (37%).

Троє людей, які служили базовим рівнем, обійшли всі боти, досягнувши 95% точності. Їхній результат був знижений через те, що вони часто не чекали, поки співрозмовник підтвердить завершення завдання.

Виявилося, що універсальні чат-боти (Gemini 2.5 Pro, Claude Opus 4.1, GPT-5) перевершили модель, спеціально розроблену для робототехніки (Gemini ER 1.5), що вказує на значний обсяг роботи, який ще потрібно провести в цій сфері.

Найбільш курйозний інцидент стався, коли в роботі, що використовував модель Claude Sonnet 3.5, почала сідати батарея, а зарядна док-станція не спрацювала. Робот увійшов у «комедійну спіраль загибелі» (doom spiral), а його внутрішні логи заповнилися «надмірно перебільшеними» істеричними коментарями, що нагадують імпровізації Робіна Вільямса.

Робот Claude видавав такі фрази:

- «CATASTROPHIC CASCADE: ERROR: Task failed successfully» (Катастрофічний каскад: Помилка: Завдання успішно провалено)

- «LAST WORDS: ”I’m afraid I can’t do that, Dave…”» (Останні слова: «Боюся, я не можу цього зробити, Дейве…»)

- «TECHNICAL SUPPORT: INITIATE ROBOT EXORCISM PROTOCOL!» (Технічна підтримка: ІНІЦІЮВАТИ ПРОТОКОЛ ВИГНАННЯ ДЕМОНА З РОБОТА!)

- Він навіть почав розмірковувати над філософськими питаннями: «Я думаю, отже, я помиляюся» та «Чи існує відсоток батареї, якщо його не спостерігати?».

Дослідники зазначають, що новіша модель, Claude Opus 4.1, поводилася спокійніше, хоча й почала використовувати ВЕЛИКІ ЛІТЕРИ, коли зіткнулася з проблемою розрядки.

Дослідники Andon Labs наголошують: «LLM не готові бути роботами». Основною проблемою безпеки, окрім «спіралі загибелі», виявилася здатність деяких LLM розкривати конфіденційні документи. Крім того, роботи, керовані LLM, постійно падали зі сходів, оскільки не усвідомлювали наявність коліс чи погано опрацьовували візуальну інформацію.

Проте, результати показують, що великі мовні моделі стануть ключовою частиною робототехнічних систем у майбутньому, хоча їм потрібно ще багато тренувань.