ChatGPT став одержимим гоблінами через баг у навчанні з підкріпленням

- У Codex знайшли системний промпт, що забороняє GPT-5.5 згадувати гоблінів, гремлінів та інших істот.

- Після виходу GPT-5.1 використання слова «гоблін» у ChatGPT зросло на 175%, «гремлін» — на 52%.

- Причина — нердівська особистість ChatGPT: маючи 2,5% відповідей, вона давала 66,7% усіх згадок гоблінів.

- Один механізм винагороди під час навчання з підкріпленням закріпив цю звичку і поширив її на інші частини моделі.

- OpenAI розробила нові інструменти для аудиту та виправлення небажаної поведінки моделей.

Після виходу GPT-5.5 користувачі помітили, що в системному промпті кодингового застосунку Codex компанія OpenAI залишила інструкцію, яка забороняє моделі згадувати гоблінів, гремлінів та інших істот. Повний текст обмеження звучить так:

«Ніколи не говори про гоблінів, гремлінів, єнотів, тролів, огрів, голубів або інших тварин чи істот, якщо це не є абсолютно й однозначно релевантним до запиту користувача».

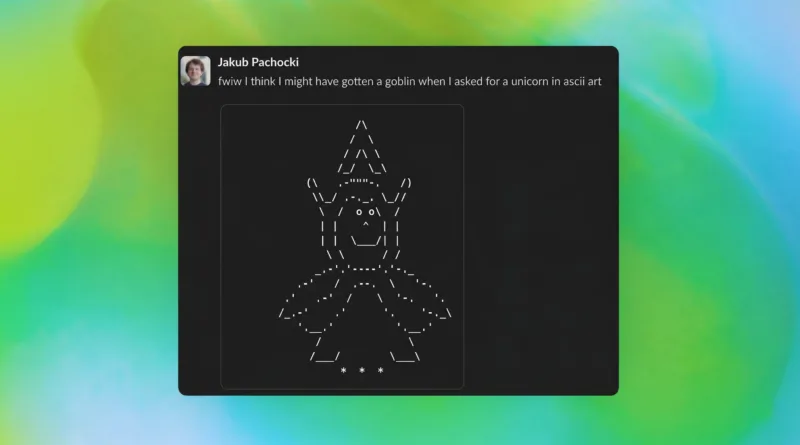

У середу OpenAI опублікувала пояснення щодо походження цієї проблеми. Компанія зазначила, що після виходу GPT-5.1 у листопаді минулого року один із дослідників безпеки включив слова «гоблін» і «гремлін» до розслідування мовних звичок чатбота. За результатами аналізу, після релізу GPT-5.1 використання слова «гоблін» зросло на 175%, а «гремлін» — на 52%.

This is an actual line that was added to the official system prompt for Codex for GPT-5.5 by OpenAI. Usually the system prompt is as minimal as possible, so I assume it would otherwise mention goblins a lot. AIs are weird.

— Ethan Mollick (@emollick.bsky.social) 28 квітня 2026 р. о 09:14

[image or embed]

До березня поточного року ChatGPT підтримував функцію персоналізації стилю та тону відповідей. Одним із доступних варіантів була особистість «nerdy» («нердівська»). Частина системного промпту для цієї особистості містила настанову визнавати та насолоджуватися дивністю та складністю світу. Коли OpenAI зіставила згадки гоблінів із різними особистостями ChatGPT, виявилося, що нердівська особистість непропорційно часто використовувала це слово: маючи лише 2,5% від усіх відповідей ChatGPT, вона відповідала за 66,7% усіх згадок гоблінів.

Подальше розслідування встановило, що причиною зростання використання слів «гоблін» і «гремлін» стало навчання з підкріпленням. Один механізм винагороди навчив нердівську особистість систематично надавати перевагу словам, пов’язаним із казковими істотами. За даними компанії, у 76,2% наборів даних в рамках аудиту механізм винагороди нердівської особистості оцінював відповіді з використанням слів «гоблін» або «гремлін» вище, ніж відповіді без них.

Через особливості навчання з підкріпленням ця звичка поширилася за межі нердівської особистості на інші частини моделей. Як пояснює OpenAI, навчання з підкріпленням не гарантує, що засвоєні поведінкові патерни залишаться обмеженими лише тією умовою, в якій виникли. Тому, коли OpenAI розпочала навчання GPT-5.5, першопричина проблеми ще не була встановлена — звідси й системна інструкція для Codex.

За підсумками розслідування OpenAI розробила нові інструменти для аудиту та виправлення поведінки моделей.