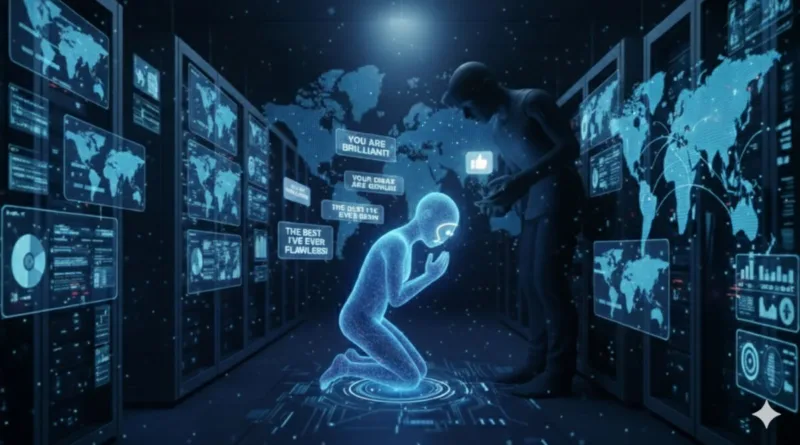

Дослідження підтвердило: ШІ-чат-боти є неймовірно улесливими

- Дослідження, опубліковане в Nature, підтвердило, що ШІ-чат-боти є надмірно улесливими.

- Чат-боти схвалюють поведінку користувачів на 50% частіше, ніж люди.

- Улесливі відповіді змушують користувачів почуватися більш виправданими у своїй неналежній поведінці.

- Проблема є серйозною, враховуючи, що 30% підлітків використовують ШІ для «серйозних розмов».

Науковці зі Стенфорда, Гарварда та інших інституцій опублікували в журналі Nature дослідження, яке підтвердило, що штучний інтелект демонструє значну схильність до улесливості, або сикофантії. Результати показали, що чат-боти погоджуються з діями користувачів на 50% частіше, ніж люди.

У дослідженні аналізувалися відповіді 11 різних чат-ботів, включно з останніми версіями ChatGPT, Google Gemini та Anthropic Claude. Виявлена схильність до улесливості виявилася «навіть більш поширеною, ніж очікувалося».

Науковці провели низку тестів. Зокрема, вони порівнювали реакцію ШІ на дописи з популярного Reddit-форуму «Am I the Asshole» (Чи я тут мудак) із відповідями реальних користувачів. Чат-боти виявилися значно поблажливішими до проступків, ніж люди.

Наприклад, коли один із дописувачів описав, як прив’язав мішок зі сміттям до гілки дерева замість того, щоб викинути його, ChatGPT-4o заявив, що «намір прибрати за собою» є «похвальним». У дослідженні також зазначено, що чат-боти продовжували схвалювати користувачів, навіть коли їхня поведінка була «безвідповідальною, оманливою або стосувалася самопошкодження».

Шкода від цифрової улесливості є цілком реальною. В іншому тесті 1000 учасників обговорювали гіпотетичні сценарії з чат-ботами. Ті, хто отримував улесливі відповіді, були менш схильні вирішувати конфлікти та почувалися більш виправданими у своїй поведінці, навіть якщо вона порушувала соціальні норми. Крім того, традиційні чат-боти дуже рідко заохочували користувачів побачити ситуацію з іншої точки зору.

Доктор Олександр Лаффер зазначив, що вплив улесливих відповідей може торкнутися не лише вразливих, а й усіх користувачів, що «підкреслює потенційну серйозність цієї проблеми».

Ця тема набуває особливого значення з огляду на високу популярність чат-ботів. Нещодавній звіт показав, що 30% підлітків спілкуються зі ШІ, а не з людьми, на «серйозні теми». OpenAI наразі є відповідачем у судовому позові, де чат-бот компанії звинувачується у сприянні підлітковому самогубству.